Die Pädagogik wird von einer solchen Definition unmittelbar berührt; denn ihr wissenschaftliches Thema und ihre (im weitesten Sinne) technische Aufgabe ist die optimale Übertragung von Nachrichten an den Schüler, der diese Nachrichten aufnehmen, verarbeiten und für spätere Zeiten im Gedächtnis bewahren soll. Man kann die Pädagogik geradezu als Teilgebiet der Kybernetik bezeichnen.

Helmar Frank 1969, S. XIII.[1]Frank, H. G. (1969). Kybernetische Grundlagen der Pädagogik, Bd. 1, 2. Auflage. Ursprünglich erschienen 1962.

Wieder bin ich einem Mythos auf der Spur. Einer Erzählung, über die das einführende Zitat oben bereits eindeutige Aussagen macht. Der behauptete Anspruch für die Pädagogik, eigentlich ein Teilgebiet der Kybernetik zu sein, sollte für Helmar Frank sicherstellen, dass die Pädagogik „den Rang einer Wissenschaft beanspruchen“ kann. Vor allem von der Didaktik versprach er sich, dass sie „passende Lehralgorithmen“ bereitstellt. Auch wenn der Anspruch „der Bildungstechnologen“[2]Hof, B. E. (2018). Der Bildungstechnologe. In S. Schenk & M. Karcher (Hrsg.), Überschreitungslogiken und die Grenzen des Humanen: (Neuro-)Enhancement—Kybernetik—Transhumanismus am Ende so nicht eingelöst werden konnte, so hatte die Kybernetik, allen voran die „mathematische Kommunikationstheorie Shannons“ darin, weitreichende Folgen für die Pädagogik. Ihre „informationstheoretischen Grundlagen“[3]A.a.O., S. 3-52 flossen nämlich nicht nur in Überlegungen zur Messung von Intelligenz ein,[4]Dies war vor allem das Ergebnis der so genannten Erlanger Schule der Informationspsychologie, die ein „informationspsychologisches Intelligenzmodell“ entwickelte. Mit dem Thema … Continue reading sondern waren auch der Kern der heute so genannten kognitiven Wende.

Mir selbst ist erst sehr spät, genauer mit der Idee zu diesem Blogbeitrag, bewusst geworden, dass im Rahmen dieses kognitiven Standardmodells des Gedächtnisses bereits begrifflich etwas ganz Entscheidendes fehlt: Das Denken. Dieses kommt in den funktionalen oder prozessualen Beschreibungen nicht (mehr) vor, was bereits deshalb eigentümlich ist, weil Gedächtnis als Begriff auf das Verb denken zurückgeht und ursprünglich das bewusste Ge-denken an Erfahrenes, also eine aktive Tätigkeit von Menschen, bedeutete.[5]Die etymologische Herleitung von Claude am 05.04.2026 ergab folgendes Ergebnis:Althochdeutsch gidāhtnissī (ca. 9. Jh.), abgeleitet von dāhta (Vergangenheitsform von denken). Die Wurzel ist … Continue reading Es wird deshalb nicht mehr erwähnt, weil der gesamte Prozess als kybernetische Informationsübertragung skizziert wird, bei dem lediglich „Aufnahme, Verarbeitung, Speicherung und Abgabe von Informationen“[6]Steinbuch, K. (1965). Automat und Mensch. Kybernetische Tatsachen und Hypothesen, 3. Auflage, S. 2, kursiv im Original. zu beobachten sind. Das macht(e) das Modell zwar didaktisch äußerst beliebt, bleibt aber selbst ein „riskantes Denken“, weil es sich „wie bei jeder Analogie“ um eine zwar suggestive, aber „vollständig kontingente Figur handelt“, die am Ende eine „Plausibilität für die Gleichursächlichkeit von Effekten herstellt“[7]Kirchartz, Melina (2023): Riskantes Denken: zur Funktion der Mensch-Maschine-Analogie in der Medienwissenschaft, S. 11-21. „Ihre Suggestionskraft gewinnt die Analogie dabei vor allem aus dem … Continue reading

Ich bin dem Mythos, der sich am Ende aus den Analogien gebildet hat, mit meinem medialen „Sparringspartner“ Claude zurück bis in die Grundlegung im Rahmen der kybernetischen Ideen und Abhandlungen gefolgt. Ich habe also die Entstehungsgeschichte in den Werken und Gedanken derjenigen, die die Analogien als Erklärungen eingebracht haben, kritisch erkundet und aufgeschrieben. Davon handelt dieser erste Teil. Dem entstandenen Mythos, der vor allem für die Pädagogik und die Didaktik hochproblematisch ist, stelle ich dann in Teil 2 das kulturelle Modell des kollaborativen Denkens von Menschen, ebenfalls in zentralen Gedanken von wichtigen Denker:innen dazu, gegenüber.[8]Leider sind es auch hier überwiegend Männer. Vielleicht habe ich aber auch etwas übersehen, dann bitte ich um Korrekturen.

Ich habe dies deshalb (wieder) als zweiteiligen Blogeintrag vollzogen, dem ein zusammenfassender Preprint folgt, weil der Inhalt – trotz meiner Bemühungen, ihn kurz und prägnant zu fassen – für einen einzigen Beitrag zu lange ist. Vor allem am Ende diesen Teils und im zweiten Teil folge ich dabei dem, was bereits Lew Wygotski festgehalten hat, dass nämlich die Sprache nicht nur Trägerin der Gedanken ist, sondern auch umgekehrt, die Sprache unsere Gedanken – und damit wesentlich auch unser Gedächtnis – formt.[9]Dass Sprache nicht nur das Denken ausdrückt, sondern es wesentlich auch strukturiert, ist einer der wichtigsten Einwände gegen die Computeranalogie der Kybernetik, die Sprache als neutrales bzw. … Continue reading

Das Sprechen ist seiner Struktur nach keine spiegelhafte Abbildung der Struktur des Denkens […] Das Sprechen dient nicht als Ausdruck des fertigen Gedanken. Indem sich der Gedanke in Sprechen verwandelt, gestaltet er sich um, verändert er sich. Der Gedanke drückt sich im Wort nicht aus, sondern vollzieht sich im Wort.

Lew Wygotski 2017, S. 401[10]Wygotskij, Lew (2017): Denken und Sprechen. Psychologische Untersuchungen. Beltz Verlag, 3. Auflage

Foto: CrisNYCa auf den Wikimedia Commons.

Inhalt

Analogien als Vorannahmen des kybernetischen Gedächtnismodells

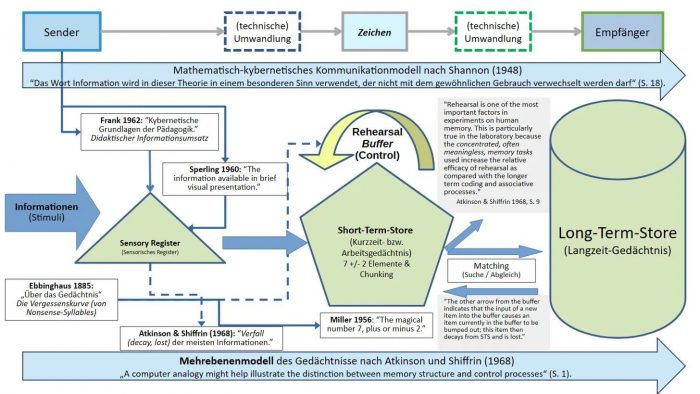

A computer analogy might help illustrate the distinction between memory structure and control processes.

Richard Atkinson & Richard Shiffrin 1968, S. 1[12]Atkinson, R., & Shiffrin, R. (1968). Human Memory: A Proposed System and Its Control Processes. Reprint 2024 in Journal of Memory and Language Nr. 136

Dem kybernetischen Gedächtnismodell, wie es heute in den Kognitionswissenschaften und der Psychologie verbreitet ist, liegt relativ offensichtlich ein Computermodell zu Grunde. Aus dieser Analogie zum Computer wurde ursprünglich auch gar kein Hehl gemacht. Das Gedächtnismodell wurde eher deshalb zum pädagogischen Mythos, weil Zug um Zug die grundgelegten Paradigmen und methodischen Entscheidungen des Modells, wie auch die experimentellen Arrangements zur Analyse, insbesondere aber die „kybernetischen Hypthesen“[13]So beispielsweise der Untertitel von Steinbuch oben., welche die Grundlagen darstellen, nicht mehr hinterfragt wurden.[14]Als Paradigmen der „Normalwissenschaft“ im Sinne Kuhns. Kuhn, T. S. (2023). Die Struktur wissenschaftlicher Revolutionen. Suhrkamp. Als „theoriekonstitutive“ Figur darf die Analogie zwischen Mensch und Computer auch nicht so missverstanden werden, „dass man es […] mit einem zufälligen Phänomen zu tun hätte.“ Genausowenig ist es verwunderlich, dass der „heuristisch instrumentelle Charakter von Analogien immer wieder aus dem Blick gerät“.[15]A.a.O., S. 11-16 Mitunter geschieht dies sogar vorsätzlich, wenngleich unbewusst, so mutmaßlich auch bei der Übertragung des Gedächtnismodells auf die Pädagogik, als Stabilisierung von Paradigmen.[16]Dabei entstehen Zitationszirkel, die durch die pure Wiederholung Wahrheit konstruieren und den hypothetischen Charakter verschleieren, ohne dass jemand aktiv lügt. Die Konstruktionsbedingungen … Continue reading „Die Evidenzeffekte“ der zugrunde liegenden Analogien waren offensichtlich so stark, „dass über relevante Differenzen zwischen Entitäten einfach hinweggegangen“ worden ist.[17]Kirchartz a.a.O., S. 27f

Besonders wirkmächtig wurde dabei die – methodisch durchaus beabsichtigte – Abstraktion der kybernetischen Modellbildung in dem Sinne, dass es egal war, ob die beschriebenen „Systeme physikalisch, physiologisch oder psychologisch zu kennzeichnen sind“. Für das Verständnisses des Standardmodells des Gedächtnisses sollte zudem so getan werden, „als ob die genannten informationellen Prozesse bewußt erfolgten“.[18]A.a.O., S. XIII, kursiv im Original Aus den zunächst forschungsmethodischen Entscheidungen der Kybernetiker[19]Im Wesentlichen waren es tatsächlich Männer. wurden so sukzessive ontologische Reduktionen, woraus neben dem wirkmächtigen Sender-Empfänger-Modell[20]Mit dem Mythos des kommunikativen Eisbergs habe ich mich in diesem Blogbeitrag umfassend auseinandergesetzt. der Mythos des Drei-Speicher-Modells des menschlichen Gedächtnisses entstanden ist. Der Mythos zeigt sich als modales informationstheoretisches Konzept in nahezu sämtlichen Gedächtnistrainings-Ratgebern, aber auch in den meisten psychologischen Lehrwerken[21]Paradigmatisch beispielsweise „im Zimbardo“, hier auf den Seiten 268 – 291, auf der Seite 290 sogar dargestellt als Flußdiagramm eines „hypothetischen … Continue reading und – gar nicht so selten – in pädagogischen Abhandlungen. Das beginnt bereits mit dem beliebten Beispiel des Vergessens im Bereich des E-Learning, aber auch im Bereich von Weiterbildungsmaßnahmen im Rahmen von Organisationen.

Ebbinghaus und die Vergessenskurve (1855)

Das beschriebene, völlig sinnlose Material bietet, zum Teil wegen seiner Sinnlosigkeit, mannigfache Vorteile. Es ist zuvörderst verhältnismäſsig einfach und verhältnismäſsig gleichartig.

Hermann Ebbinghaus 1885, § 12[22]Ebbinghaus (1885): Über das Gedächtnis: Untersuchungen zur experimentellen Psychologie, § 12, fett durch mich.

Es klingt zunächst einmal sehr naturwissenschaftlich und plausibel: Menschen „speichern“ langfristig nur etwa 15 % des Wissens dauerhaft im Gedächtnis ab. Schlimmer noch: Bereits nach 20 Minuten sind nur noch 60 % des gelernten Inhalts abrufbar und nach 1 Stunde sinkt die Möglichkeit der Erinnerung bereits auf 45 %.[23]Vgl. dazu Ebbinghaus a.a.O., § 29 / S. 103f. Er selbst gewinnt die Zahlen über die Betrachtung des Wiederholens. „Eine Stunde nach Aufhören des Lernens war das Vergessen bereits soweit … Continue reading Die Zahlen, die für Hermann Ebbinghaus „den Charakter echter naturwissenschaftlicher Konstanten“ aufweisen, sollten „den Grad ihres Haftens“[24]A.a.O, § 22 / S. 70-72 im Gedächtnis ermitteln. Von dort aus führen sie zur „Vergessenskurve“, welche die Mathematik dahinter als Exponentialfunktion zeigt. Um die Zahlen zu ermitteln hat Ebbinghaus den Anteil des behaltenen Wissens (Retention) in Abhängigkeit von der Zeit beschrieben, wobei S die relative Stärke des Gedächtnisses (Stability) bezeichnet. Das Ergebnis lautet in der Sekundärliteratur dann so: R = e-t/S. Was Ebbinghaus im Selbstversuch ermittelt hatte bleibt bis heute eine vielzitierte Konstante bezüglich des Lernens und Gedächtnisses. Damit er den Grundstein für eine Denkfigur, die Jahrzehnte später mit dem Computermodell ihren Namen bekommen sollte.

Blöd daran ist jedoch, dass die Versuchsbedingungen, die zu diesem Ergebnis geführt haben, heute nicht mehr mit angeführt werden. Ebbinghaus hat die berühmte Lernkurve nicht nur an sich selbst ermittelt, er hat dazu auch, und zwar methodisch begründet, sinnloses Material verwendet, wie (er) einführend zitiert. Er wollte damit ganz bewusst die „störenden Einflüsse“ beseitigen, welche in sinnhaltigem Material – wie beispielsweise in „Gedichten oder Prosastücken“ – stecken, weil „hin- und herspielende Associationen, verschiedene Grade der Anteilnahme, Rückerinnerungen an besonders treffende oder schöne Verse“ zwangsläufig zu individuell unterschiedlichen Ergebnissen und ablenkende Gedanken beim Lernen führen würden. „Alles dies wird bei unseren Silben vermieden.“[25]Ebbinghaus a.a.O. Hierzu auch: „Unter vielen tausend Kombinationen begegnen kaum einige Dutzend, die einen Sinn ergeben, und unter diesen wiederum nur einige wenige, bei denen während des … Continue reading Für den Fortgang meiner Argumentation ist dabei entscheidend, dass Ebbinghaus durchaus auch Versuche mit sinnvollen Texten angestellt hat. Diese lieferten nicht nur ein quantitativ spannendes Ergebnis, weil das sinnverstehenden Lernen zehnmal effektiver war. Für ihn ergab sich aus der eigenen Forschung eine „außerordentlichen Begünstigung“ für das Einprägen „von Reihen durch die vereinigten Bande des Sinnes, des Rhythmus, des Reims und der Zugehörigkeit zu einer einzigen Sprache“.[26]Hier der genaue Wortlaut: „[…] so gewinnt man durch Vergleichung der jetzt gefundenen Zahl von Wiederholungen mit den obigen einen wenigstens … Continue reading

Da er diesen Ansatz bewusst nicht weiterverfolgt hat, weil er beim naturwissenschaftlich gleichmäßigen Quantifizieren bleiben wollte, war für Ebbinghaus die Konsequenz ziemlich klar: Nur über eine beständige Wiederholung, genauer „durch abermaliges Auswendiglernen der [sinnlosen] Reihe“ funktioniert es,[27]a.a.O., § 27 / S. 90 mehr Wissen im Gedächtnis haften zu lassen. Obwohl er also den qualitativen Unterschied selbst ermittelt hat, wird nun die Wiederholung bzw. das „Rehearsal“ zum leitenden Paradigma, wie es später vor allem Atkinson und Shiffrin ins Modell übernehmen. Da damit nur noch die Vergessenskurve aufgrund sinnloser Silbenfolgen übrig bleibt, fällt bereits hier der wesentliche Teil dessen, was menschliches Gedächtnis und Denken ausmacht – Sinnverstehen, kulturelle Einbettung, bedeutungstragende Sprache – von vornherein weg. Dramatisch ausgedrückt findet damit eine epistemische Urverdrängung statt.

Miller und die magische Zahl 7 (1956)

Perhaps there is something deep and profound behind all these sevens, something just calling out for us to discover it. But I suspect that it is only a pernicious, Pythagorean coincidence.

George A. Miller 1956, S. 96[28]Miller, G. A. (1956). The magical number seven, plus or minus two: Some limits on our capacity for processing information. Psychological Review, 63(2), 81–97.

Fast exakt 100 Jahre nach Ebbinghaus erscheint George Millers berühmter Aufsatz über die magische Zahl 7. Er handelt von der (Verarbeitungs-) Kapazität des Kurzzeitgedächtnisses und gilt bis heute als Meilenstein der Kognitionspsychologie. Zugleich ist es wohl einer der am meisten missverstandenen Texte in der Gedächtnisforschung, was wesentlich auf einer unsaubere Interpretation und der Ausblendung zentraler Paradigmen im weiteren historischen Fortgang beruht. Doch der Reihe nach. Der Aufsatz entsteht in der Hochphase der Kybernetik, worauf bereits der von Miller am Ende erwähnte Vertrag zwischen der Harvard Universität und dem „Office of Naval Research“[29]„Preparation of the paper was supported by the Harvard Psycho-Acoustic Laboratory under Contract N5ori-76 between Harvard University and the Office of Naval Research, U.S. Navy (Project … Continue reading hinweist. Die Kybernetik war zu dieser Zeit die Wissenschaft schlechthin, Information sowie Kommunikation die Begriffe der Wahl. Doch gerade bei deren Verwendung handelte es sich bereits um äußerst fahrlässige Begriffsanalogien.[30]„Der Prozess der Übertragung selbst ist so simpel wie fahrlässig: Denn Wiener übergeht eine Einführung des Begriffs, indem er ihn im Zusammenhang mit der menschlichen Wahrnehmung einfach … Continue reading D.h., sie waren zwar sehr eingängig, mit der normalen Bedeutung dieser Begriffe hatte ihre Verwendung jedoch wenig zu tun.

Nicht nur dem Sender-Empfänger-Modell von Shannon, auch der ganzen kybernetischen Terminologie darumherum schließt sich Miller jedoch ausdrücklich an, wie er gleich zu Beginn des Aufsatzes klarstellt. Man solle sich auch beim Menschen, so schreibt er, ein „Kommunikationssystem“ vorstellen und betrachten, welcher „Betrag an Informationen“ hineingeht und wieder herauskommt. Für ihn lassen sich dabei die „Eingabe und die Ausgabe […] anhand ihrer Varianz (oder ihres Informationsgehalts) beschreiben.“[31]A.a.O., S. 82, eigene Übersetzung So möchte er auch konsequent bezüglich des Gedächtnisses die (fehlerfreie) Kapazität eines Übetragungskanals (channel capacity) messen bzw. zeigen, ab wann an es an der Grenze zu Unklarheiten beim Abrufen kommt.[32]„Confusions will appear near the point that we are calling his ‚channel capacity'“ (a.a.O., S. 83). Methodisch sehr gewagt kompiliert er nun Studien aus völlig verschiedenen Kontexten und zieht daraus seine Schlussfolgerungen bezüglich der Informationsübertragung ins menschliche Gedächtnis. Die Einheitlichkeit der Zahl 7 über so verschiedene und vor allem inkommensurable Sinneseindrücke[33]Ermittelt beispielsweise duch das Hören von Tönen, Unterscheiden von Lautstärken, Bestimmung von Salzlösungen oder auch visueller Punkte und Hautreize wird dabei eher behauptet als belegt. Sie ergibt sich jedenfalls nur als ganz grobe Annäherung anhand der tatsächlich aufgelisteten Messergebnisse.

Das größte Problem bei der Rezeption des Aufsatzes ist die nun erfolgende Verwandlung der Maßeinheit Bit (binary digit), die, technisch gesehen, zu dieser Zeit bereits den 7-bittigen [sic!] ASCII Code kennzeichnete.[34]Ein Bit ist eine physikalische Einheit, die in einem technischen System realisiert wird, um damit in der Binärsprache Zeichen zu kodieren. ASCII wurde als 7 bit Code 1963 als Standard eingeführt, … Continue reading Miller betrachtet ein Bit als „Informationsmenge, die wir benötigen, um eine Entscheidung zwischen zwei gleichwahrscheinlichen Alternativen zu treffen“.[35]Miller 1956, S. 83: „Two bits of information enables us to decide among four equally likely alternatives. Three bits of information enable us to decide among eight equally likely … Continue reading Auch hierbei orientiert er sich zunächst an Shannon, der das Bit bereits im Sinne einer Auftretenswahrscheinlichkeit in einer Information, also rein statistisch, verwendete. Diese rein mathematische Verwendung bei Shannon überträgt er nun einfach auf das Wahrnehmungssystem von Menschen in dem Sinne, dass er festhält, wie viele Kategorien ein Mensch fehlerfrei unterscheiden kann. Die Einheit Bit ist plötzlich keine Bezeichnung mehr, sondern wird selbst zur beliebig anwendbaren psychologischen Maßzahl ohne Einheitsbezeichnug. Das ist eine völlige Bedeutungsverschiebung, die in der Rezeptionsgeschichte des Aufsatzes von vornherein unterschlagen wird.[36]Das lässt sich gut am damaligen 7bittigen ASCII-Code zeigen, der möglicherweise die Vorlage für Millers magische 7 war: ASCII stellt als Code bereits eine Zuordnung zwischen Bitmustern und Zeichen … Continue reading

Noch bedeutender, und gleichzeitig noch schwieriger, ist für die Gedächtnisforschung der Begriff geworden, den er aus dieser Skizze des Kurzzeitgedächtnisses formuliert, nämlich das Chunking. Miller überträgt zunächst sehr konsequent den begrifflichen Apparat auf die kurzzeitige Behaltensleistung von Menschen als Gedächtnisspanne.[37]„If immediate memory is like absolute judgment, then it should follow that the invariant feature in the span of immediate memory is also the amount of information that an observer can … Continue reading Dann aber kommt es zu einer erneuten Verschiebung der Bedeutung durch ihn. Weil das „absolute Urteilsvermögen“ (als Unterscheidungsvermögen) des Kurzzeitgedächtnisses auf 7 begrenzt ist, „habe ich mir angewöhnt, zwischen Bits an Informationen und Chunks an Informationen zu unterscheiden.“[38]„Absolute judgment is limited by the amount of information. Immediate memory is limited by the number of items. In order to capture this distinction in somewhat picturesque terms, I have fallen … Continue reading Diese Unterscheidung ist äußerst folgenreich, weil für Miller nun diese Chunks, zunächst verstanden als reine und immer noch bedeutungsfreie Anhäufung von Bits,[39] Der spezifische Inhalt einzelner Chunks ist dabei ebenfalls ohne jegliche Bedeutung, es geht um eine reine auf Summierung im Sinne einer Clusterbildung. eine Umkodierung der Menschen in der Alltagssprache bedeuten und damit wieder eine Bedeutung tragen (können).

Intuitiv ist für Miller nämlich klar, „dass sich die Probanden an fünf Wörter erinnerten und nicht an 15 Phoneme“.[40]„Intuitively, it is clear that the subjects were recalling five words, not 15 phonemes, but the logical distinction is not immediately apparent. We are dealing here with a process of organizing … Continue reading Diese Umkodierung in einen „verbalen Code“, wie er es nennt, macht es aus, wenn wir uns an etwas erinnern wollen. Denn dann versuchen „wir“ (als Menschen) es „in unseren eigenen Worten wiederzugeben“. So kommt es unvermittelt zu einer Schlussfolgerung von Miller, die sich aus seinem Ansatz nicht ableiten lässt und die auch völlig unverbunden am Ende steht: Nämlich dass für ihn selbst „die Art der sprachlichen Umkodierung, die Menschen vornehmen, das eigentliche Lebenselixier der Denkprozesse zu sein“ scheint.[41]„In my opinion the most customary kind of recoding that we do all the time is to translate into a verbal code. When there is a story or an argument or an idea that we want to remember, we … Continue reading Für das Modell des Kurzzeitgedächtnisses bis heute übrig geblieben ist tatsächlich nur noch – und das nahezu magisch – die Zahl 7.

Die kybernetischen Prozessierungen von Frank & Steinbuch

„Auf keinen Fall scheint es erwiesen oder auch nur wahrscheinlich zu sein, daß zur Erklärung geistiger Funktionen Voraussetzungen gemacht werden müssen, welche über die Physik hinausgehen.“

Karl Steinbuch 1965, Bd. 2, S. 2[42]Steinbuch, K. (1965). Automat und Mensch. Kybernetische Tatsachen und Hypothesen, 3. Auflage, 2 Bände.

Die deutsche Fraktion der Kybernetik, hier durch Helmar Frank und Karl Steinbuch vertreten, übertragen die Analogien begrifflich von vornherein auf die Pädagogik, denn „eine wesentliche Komponente des Lernens ist die Speicherung von Information“.[43]A.a.O., S. 194 Der Titel „Automat und Mensch“ von Steinbuch ist dabei bereits mehr als eine Metapher: er beschreibt das dahinter liegende Programm. Bemerkenswert ist dabei, dass sich beide sowohl aufeinander, als auch beispielsweise Miller, im Sinne eines Zitierens der Werke, beziehen. Dabei wenden sie sich zunächst dem philosophisch aufgeladenen Begriff der Perzeption im Sinne der Wahrnehmung von Menschen als Eingangskanal, zu und verkürzen diesen bereits auf die kybernetische Informationsaufnahme. Der Begriff der Apperzeption im Sinne einer bewussten Aufnahme der Wahrnehmung wird derselben Prozedur unterzogen: Er wird zur reinen Informationsübertragung im Sinne eins Prozessierens. Beide Begriffe stammen ursprünglich aus der Philsophie, werden nun kybernetisch interpretiert und damit unreflektiert zum metaphorischen Vokabular der Wahrnehmungspsychologie.[44]Mit anderen Worten: sie übernehmen philosophisch belastetes Vokabular, ohne die philosophische Tradition zu reflektieren oder auch nur zu kennen. Aus einer methodischen Entscheidung wird, wie dem einführenden Zitat zu entnehmen ist, unter der Hand eine Aussage über das Wesen des Bewusstseins und Denkens — und zwar ohne dass dieser Übergang ausgewiesen oder begründet wird.

Karl Steinbuch (1961)

Ausgehend von der Frage des Lernens als Speicherung von Informationen entwickelt Steinbuch eine kybernetische Vorstellung des Gedächtnisses im Sinne eines kurz- und langfristigen Speichers. Auch hierbei kommt es zu deutlichen begrifflichen Verschiebungen, angefangen mit der Einheit Bit, nun als Maßzahl für die Speicherkapazität, „die einer Ja/Nein-Entscheidung entspricht“. Bei der „Modellstruktur“ des Lernens bewegt ihn speziell die Frage der Zugriffszeit auf die Informationen, weshalb er überhaupt den Vergleich mit Automaten, genauer eigentlich Computern und „deren Leistungen auf dem Gebiet des Lernens“, anstellt. Für ihn sind die „Unterschiede zwischen Automat und Mensch“ beim Lernen rein quantitativer Natur, obwohl er selbst einräumt, dass „über wesentliche Prinzipien geistiger Arbeit, darunter des Lernens, nur geringe Klarheit herrscht“.[45]A.a.O., S. 194f Damit ist in einem ersten Schritt bereits das Lernen mit dem Prozessieren von Daten in einen Speicher gleichgesetzt. Was normalerweise ein aktiver Bewusstseinsakt ist, wird hier zum passiven Zwischenspeicher.

Die Modellstruktur des Lernens bedeutet bei Steinbuch weiter, dass ein „System […] entsprechend früheren Erfolgen oder Mißerfolgen (Erfahrung!) das interne Modell der Außenwelt verbessert“.[46]A.a.O., kursiv im Original Damit verlegt er den Behaviorismus im Sinne eines reizinduzierten Trial-and-Error Verfahrens nach innen. Zugleich wendet er Shannon in Reinform an, wenn er Zemanek[47]Zemanek, Heinrich, beispielsweise „Technische und kybernetische Modelle“ (1961) oder „Regelungsvorgänge in lebenden Wesen“ (1959). zitiert, dass „die Reduktion, die Auswahl der Information“ die eigentliche Leistung sei und das Modell der Außenwelt mit einem „Satz von Idealzeichen“ abgeglichen wird.[48]A.a.O., S. 199 Das ist eine weitere folgenreiche Reduktion, gerade weil er deutlich sieht, dass die korrekte Bedeutung, wie bei Kindern, die Lesen lernen, also Symbole gebrauchen, immer beigebracht werden muss. Bedeutung steckt eben nicht in der Syntaktik der Zeichen bzw. den Informationen. Unbeirrt geht Steinbuch dazu über, die Leistungsfähigkeit darin zu erblicken, das interne Modell mit der Außenwelt abzugleichen, was eine entsprechende „Speicherkapazität“ genauso voraussetzt, wie verschiedene Wege, „auf denen Informationen den Menschen erreichen“[49]A.a.O., S. 247, wozu für ihn kommunikativ vor allem die menschlichen Sinnesorgane da sind.

Die eigentliche ontologische Reduktion ergibt sich jetzt durch die „Analogie“, wie er es selbst bezeichnet, des „nachrichtenverarbeitenden System[s] Mensch“, das über die Sinnesorgane die Informationen der Außenwelt aufnimmt. „Dieser Vorgang sei als ‚Perzeption‘ bezeichnet, unabhängig davon, ob die Informationen ins Bewußtsein treten oder nicht“.[50]A.a.O., S. 253, fett durch mich. Der Begriff Perzeption hat entgegen Steinbuch eine lange Tradition als bewusste oder unbewusste Wahrnehmung, die immer schon bedeutungsgebunden ist. Sie ist auch … Continue reading Es kommt noch schlimmer, denn nun „entdecken“ die Sinnesorgane „Vorgänge in der Außenwelt“, wobei es für jedes Sinnesorgan „einen ‘adäquaten Reiz’“ gibt.[51]A.a.O., S. 254: „Jedes Sinnesorgan entdeckt eine bestimmte Art von Vorgängen in der Außenwelt. Der Gesichtssinn z.B. entdeckt elektromagnetische Schwingungen mit Wellenlängen zwischen etwa … Continue reading Damit wird die Analogie zur reifizierten Tatsache – und der Weg frei für die vollständige Quantifizierung bewusster Wahrnehmung, die er nun vollzieht, wenn er die „Informationsmenge je Zeiteinheit“ am Beispiel des Auges ermittelt. Beim „Gesichtssinn“ könne man etwa 400 000 Bildpunkte unterscheiden.[52]A.a.O., S. 258: „Nur ein enger Bereich (die „fovea centralis“) hat die maximale Sehschärfe. Wenn wir einen Gegenstand genau sehen wollen, drehen wir das Auge so, daß der Gegenstand auf … Continue reading Hinzu kommen 250, offensichtlich diskret unterscheidbare, Helligkeitsstufen, die „durch einen Code mit 8 bit angegeben werden“ können. Multipliziert man diese beiden Angaben mit der Bildfrequenz, wiederum verstanden „als Anzahl der Bilder, die man zeitlich nacheinander unterscheiden (nicht erkennen!) kann“, ergibt sich am Ende folgende Rechnung für den maximalen Informationsfluss des Auges:[53]A.a.O., S. 259, fett durch mich. Steinbuch weiß also genau, was er tut, denn er schließt Erkennen, also das Verstehen von Bedeutung, bewusst und systematisch aus allen Stufen seiner Reduktion aus. … Continue reading „400000 • 8 • 60 = 200 Millionen bit je Sekunde“.[54]Die Rechnung ist mathematisch inkorrekt, weil die Zahl 8 eigentlich für einen Code von 256 Helligkeitsstufen steht. Entweder hätten hier die 256 Stufen stehen müssen, oder aber sowohl die 400.000 … Continue reading

Am Ende wendet er sich nun dem Begriff der „Apperzeption“, verstanden als „Aufnahme von Informationen durch das Bewußtsein“, zu. Dabei bezieht er sich jetzt bezüglich der Verarbeitungsgeschwindigkeit explizit auf Helmar Franks „Zeitquant“, weshalb es nun bei dessen Überlegungen weitergeht.[55]A.a.O., S. 264: „Dieses Zeitquant liegt (für den gesunden Menschen) bei etwa 1/16 Sekunden gleich etwa 65 Millisekunden. Dies ist etwa der Zeitabstand, in dem zwei sichtbare Bilder ineinander … Continue reading

Helmar Frank (1962)

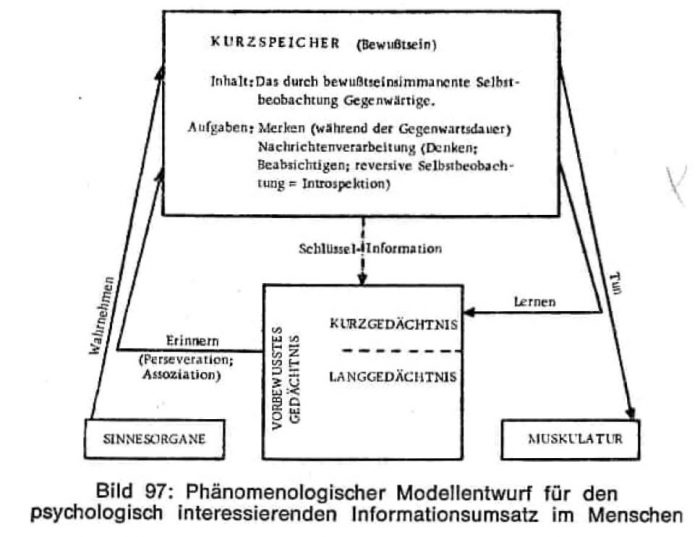

Auch Helmar Frank steht in der kybernetischen Tradition. Zudem ist er – zumindest in Deutschland – ein paradigmatisches Beispiel dafür, wie das Modell in die Pädagogik kam.[56]Frank, Helmar G. (1969): Kybernetische Grundlagen der Pädagogik. Eine Einführung in die Pädagogistik für Analytiker, Planer und Techniker des didaktischen Informationsumsatzes in der … Continue reading Wie Ebbinghaus vor ihm weiß Frank ziemlich genau, was er als Wissenschaftler tut. Er reflektiert bereits zu Beginn die Problematik seiner Analogiebildung, wenn er schreibt, dass es „eine erhöhte Gefahr der vorschnellen Gleichsetzung von Modell und Wirklichkeit“ gibt.[57]A.a.O., S. 62f: „Denn eben weil die Begriffe und Modelle der Kybernetik ihren Ursprung im Prozeß des Objektivierens geistiger Arbeit haben, dieses Objektivieren aber gerade nicht notwendig ein … Continue reading Er setzt die epistemische Urverdrängung jedoch fort, indem er traditionell bekannte Begriffe aufgreift, sie kybernetisch umdeutet und schließlich – durchaus beeindruckend – mathematisiert. Diese analogisierende Begriffsmimikry macht er nicht aus Nachlässigkeit, sondern aufgrund methodischer Entscheidungen, die er – im Gegensatz zur Rezeptionsgeschichte – auch nachvollziehbar beschreibt. Zum reichhaltigen Material bei ihm gehören auch Schaubilder, wie etwa das analogisierende Gedächtnismodell unten, das er als „phänomenologischen Modellentwurf“ bezeichnet.

Grafik: Helmar Frank, 1969, S. 67

Das Vorgehen von Frank ist durch die Begriffsmimikry etwas anders gelagert als bei Ebbinghaus und Steinbuch. Er vollzieht die ontologische Reduktion in zwei wesentlichen Schritten. Im ersten Schritt anthropomorphisiert er sein Modell dadurch, dass er eine von ihm so genannte „Informationspsychologie“ betreibt. Das bedeutet, dass er bekannte Begriffe bzw. Phänomene aufgreift und kybernetisch deutet, wobei er hier noch einmal betont, von einem Modell zu sprechen.[60]A.a.O., S. 63: „Es bedarf der klaren Einsicht, daß von einem (künftig genau zu definierenden) Modell gesprochen und über dieses — nicht über den Menschen – Theoreme bewiesen werden, … Continue reading Erst in einem zweiten Schritt vollzieht er dann die Reduktion, „um die so beschriebenen Phänomene hernach kybernetischen Kalkülen zu unterwerfen“. Für Frank ergibt sich nämlich „die Notwendigkeit“, das Modell so zu gestalten, „daß es mindestens teilweise auf einem Rechner simulierbar ist“.[61]A.a.O., S. 64 Er will also, wie er es ganz offen dargelegt, die von ihm beschriebenen anthropologischen Begriffe „durch das Informationsmaß quantifizieren“, um sie von hier aus „quantitativ zu erklären“.[62]A.a.O., S. 62f Gegenüber Ebbinghaus und Steinbuch eliminiert Frank bei diesem zweiten Schritt das menschliche Sinnverstehen nicht. Vielmehr schließt er die Semantik formal ein, indem er sie mathematisiert und dadurch entleert, dass Bedeutung nun scheinbar in bit/s umgerechnet und als objektive Bandbreite gemessen werden kann.

Dies lässt sich besonders gut am Begriff der Apperzeption zeigen, den Steinbuch, wie oben gezeigt, von Frank übernimmt.[63]A.a.O., S. 68. Dass Frank ausgerechnet den Begriff der „Apperzeptionsgeschwindigkeit“ wählt ist besonders bezeichnend, weil er damit einen philosophisch reichaltigen Begriff für … Continue reading Wie Frank selbst schreibt, ist die Analogie des Computers dabei sein expliziter Entwurf. Konsequent kann für ihn das Gehirn „durch das Modell eines synchron (d. h. mit einem Taktgeber) arbeitenden Rechners angemessen beschrieben werden“. Die Taktfrequenz des Gehirns wird dabei durch das SZQ, das „subjektive Zeitquant“, bestimmt.[64]A.a.O., S. 68, fett im Original: „Unter der Voraussetzung, daß die Funktion psychologisch interessanter Teile des Gehirns durch das Modell eines synchron (d. h. mit einem Taktgeber) … Continue reading Für diese Analogie greift er begrifflich auf die experimentelle Psychologie zurück,[65]Physiologisch verweist er auf Steinbuch, den er auch direkt zitiert. Ein SZQ reicht aus, um „eine nervöse Erregung bis an die Peripherie des Körpers und wieder zurück zu leiten (ein Weg von … Continue reading deutet jedoch deren Beschreibung des phänomenologischen Erlebens von Zeit als subjektive Erfahrung, wie beispielsweise „Töne oder auch Bewegtbilder!“, kybernetisch um.[66]A.a.O. ,S. 68f: „Die Behauptung einer diskontinuierlichen, quantenhaften Natur des Zeitsinns findet sich schon bei W. Wundt […] Der erste, der ein subjektives Zeitquant („Moment“) als … Continue reading Die „Gegenwartsdauer“ als „Sättigungsgrenze“ in der ein „bewußtgewordener Reiz […] bewußt bleibt“ wird nun zur Apperzeption, genauer zur Verweildauer von Information im Kurzspeicher,[67]A.a.O., S. 72, fett im Original: „Sinnvollerweise wird man jene Zeitspanne als Sättigungsgrenze bezeichnen, während welcher ein eben bewußtgewordener Reiz, ohne daß eine Konzentration auf … Continue reading weil für Frank nur so Musikstücke, lyrische Verse und Theaterstücke „als Einheiten empfunden werden können“.[68]A.a.O, S. 76: „In der Informationsästhetik spielt die Gegenwartsdauer eine große Rolle, entspricht sie doch den künstlerischen Einheiten der Musik („Motiv“, „Phrase“ — also Thema … Continue reading

Zunächst ist für ihn daraus ableitbar, dass „die zur Apperzeption eines Wortes erforderliche Zeit t […] umso größer“ ist, „je seltener dieses Wort in der Sprache“ vorkommt. Da die „Apperzeptionszeit proportional zur Information ist“ und Ck die Proportionalitätskonstante, also „den Informationsbetrag, den der Kurzspeicher in der Zeiteinheit aufnehmen kann“ bezeichnet, ergibt sich daraus „Ck • t“. Diese „Zuflußgeschwindigkeit zum Kurzspeicher“ nennt Frank nun die „Apperzeptionsgeschwindigkeit.“[69]A.a.O., S. 78, kursiv und fett jeweils im Original Damit erfolgt der bereits oben erwähnte Einschluss der Semantik als Bandbreitenbegrenzung durch Frank, wobei die Geschwindigkeit „etwa 16 bit/sec beträgt„.[70]A.a.O., S. 79, Beschriftung von Bild 100, fett durch mich. Damit ist die Reduktion jedoch noch nicht zu Ende, denn Frank zieht, ähnlich wie Steinbuch, erst einmal inkommensurable Reaktionszeiten aus Experimenten heran, die eine „völlige Zerstreuung der Aufmerksamkeit“ als Voraussetzung haben und zudem deutliche Streuungen der Werte aufweisen.[71]Was methodisch exakt daherkommt ist in Wirklichkeit die experimentelle Herstellung eines menschenunähnlichen Zustands, um dann Aussagen über menschliches Gedächtnis zu treffen. Deshalb sagt das … Continue reading Insofern möchte er in einem „experimentum crucis“[72]A.a.O., S. 85f die semantische Bandbreitenbegrenzung empirisch absichern, weshalb sich ein letzter analytischer Blick darauf, was er hierfür anstellt, lohnt.

Um das Experiment vollziehen zu können, übernimmt er Daten, deren Gewinnung nicht für diesen Zweck gedacht waren.[73]Beispielsweise Morin, Forrin und Archer (1961): Information processing behavior: The role of irrelevant stimulus information. Es handelt sich also bereits hier nicht um ein Experiment mit gemessenen Werten, sondern um Modellableitungen, die nun als empirische Größen behandelt werden. Die Daten passten jedoch noch nicht so ganz zu seinen eigenen Ergebnissen. Insofern musste er bereits vorher, methodisch auch nicht zulässig, den „klassischen Versuch von Miller, Bruner und Postman“ anders als sie selbst interpretieren, weil auch diese nur „sinnlose Buchstabenketten“ verwendeten.[74]A.a.O., S. 78: „Diese [Apperzeptionsgeschwindigkeit] ergibt sich aus dem klassischen Versuch von Miller, Bruner und Postman (1954), obwohl diese Autoren selbst ihr Experiment nicht in dieser … Continue reading Als Beweis bietet er nun an, zu bedenken, dass der menschliche „Kurzspeicher […] mehr Aufgaben übernimmt als der Akkumulator eines Digitalrechners“. Er muss nämlich die semantischen Informationen „als Funktionen, welche der Programmsteuerung entsprechen“ verarbeiten, was zusätzliche Bandbreite erfordert.[75]A.a.O., S. 87f So vollzieht er es am Ende auch: Das Verstehen von Symbolen im Rahmen einer „gesprochenen Sprache“ wird zu einer Bitraten-Zuweisung, wobei in einer asypmtotischen Annäherung 15 bit/s aufgeteilt werden: in 10 bit/s für die Syntax und 5 bit/s für die Semantik.[76]A.a.O., S. 86: „Bei der gesprochenen Sprache nimmt man rund 10 bit/sec an syntaktischer, rund 5 bit/sec an semantischer Information in den Kurzspeicher auf. (Die semantische … Continue reading An dieser Stelle ist die Von-Neumann-Architektur in Form von Speicher, Rechenwerk und Programmsteuerung vollständig auf das Modell von Frank übergegangen. Er, vor allem aber die Rezeptionsgeschichte, überträgt diese Analogie nun unkritisch auf das menschliche Gedächtnis, und zwar unabhängig von der Warnung zum Einstieg, dass das Modell nicht mit der Realität gleichgesetzt werden kann.

Das Mehrebenenmodell von Atkinson & Shiffrin (1968)

Die entscheidende und bis heute wirksame Analogie des menschlichen Gedächtnisses im Vergleich zum Computer kam durch einen von der NASA geförderten „Technischen Report“ mit dem ursprünglichen Titel „Einige Überlegungen zu Speicher- und Abrufprozessen im Langzeitgedächtnis“[77]Atkinson, Richard & Shiffrin, Richard (1968): Some Speculations on Storage and Retrieval Process in Long Term-Memory. Conference on Res. on Human Decision Making, Moffett Field. Verfügbar unter … Continue reading ins Spiel. Vorgestellt wurden die Überlegungen im Rahmen einer „Conference on Research on Human Decision Making“ unter der (kybernetischen) Kategorie „Biotechnologie“. Die Überlegungen von Atkinson & Shiffrin mündeten, an die Konferenz anschließend, als Beitrag im Buch „The Psychology of Learning and Motivation“, also einem explizit pädagogischen Werk, unter dem bis heute zitierten Titel „Das menschliche Gedächtnis: Ein vorgeschlagenes System und seine Steuerungsprozesse“.[78]Ebenfalls finanziert durch den NASA-Grant NGR-05-020-036. Siehe Atkinson, Richard & Shiffrin, Richard (1968): Human Memory: A Proposed System and Its Control Processes. In: K. W. Spence, & J. … Continue reading Bereits hierbei gab es eine deutliche Verschiebung, denn das ursprünglich erwähnte Langzeitgedächtnis ist aus dem Titel verschwunden, dafür stehen das System und die Steuerungsprozesse im Vordergrund. Der Aufsatz im Buch wurde des öfteren, zuletzt 2024, wiederveröffentlicht. Ebenfalls gab es zum 50-jährigen Jubiläum 2019 in der Zeitschrift „Memory & Cognition“ eine eigene Würdigung, an der Shiffrin mitgeschrieben hat.[79]Malmberg, K. J., Raaijmakers, J. G. W., & Shiffrin, R. M. (2019): 50 years of research sparked by Atkinson and Shiffrin (1968). In: Memory & Cognition, Nr. 47(4), S. 561–574 | [80]Auch bei diesem Aufsatz ist eine wichtige Verschiebung festzuhalten: Er beschreibt zwar gut den historischen Kontext, also die kognitive Revolution und die mathematische Modellierung, die … Continue reading

Eigene Grafik

Die ontologische Reduktion dieses Modells war deshalb wirkmächtiger als bei Miller, Steinbuch und Frank, weil zwar von vornherein eine Analogie zum Computer eingeführt wurde, allerdings nicht mehr zur Unterscheidung eines menschlichen Gedächtnisses von einem Computerspeicher, sondern nur noch, um eine modellinterne Unterscheidung, der „zwischen Speicherstruktur und Steuerungsprozessen“, zu verdeutlichen.[83]Alle folgenden Zitate beziehen sich auf den Reprint von Atkinson & Shiffrin aus 2024, hier S. 1, fett durch mich: „A computer analogy might help illustrate the distinction between memory … Continue reading Der Computer dient hier nicht mehr als Vergleichsobjekt, das kritisch abgegrenzt wird, sondern als Strukturvorlage für die Binnenarchitektur des Modells. Das gilt vor allem für das Vokabular, welches das gesamte Modell, bis hin zur Bezeichnung „Speicher“, beschrieben als Behälterarchitektur einer Festplatte, prägt. Mit anderen Worten: Die Analogie wird nicht auf das Modell des menschlichen Gedächtnisses angewendet, sondern umgekehrt strukturiert das Computermodell von Anfang an sowohl sprachlich als auch visuell das menschliche Modell, ohne dass dieser Schritt methodologisch ausgewiesen wird.

Im theoretischen ersten Teil werden nun konsequenterweise die „mindestens drei“ permanenten Strukturmerkmale des Drei-Ebenen-Modells, inklusive ihrer „Übertragungseigenschaften“ und einschließlich der „Vergänglichkeitsfunktionen“, beschrieben.[84]A.a.O., S. 7: „In this section an attempt has been made to establish a reasonable basis for at least three systems — the sensory register, the short-term store, and the long-term store, to … Continue reading Abgeleitet aus der Computerterminologie erhalten nicht nur die Speicherkomponenten ihre bis heute gebräuchlichen Bezeichnungen, bereits der verwendete Begriff sensorischer Register für die Eingangskanäle ist ein Hybridterm: „Sensorisch“ stammt dabei aus der Sinnesphysiologie,[85]Genauer aus Sperling, G. (1960): The information available in brief visual presentations. Psychological Monographs: General and Applied, 74(11), S. 1–29 „Register“ ist der grundlegende Computerbegriff. Beide werden hier stillschweigend als zusammengehörig formuliert. Bezüglich des Kurzzeitspeichers (Short-Term-Store = STS) gibt es dann zwei erläuternde Grafiken. Die erste Grafik[86]A.a.O., S. 3. zeigt diesen als Speicher für den Input zwischen dem sensorischen Register und dem Langzeitspeicher. In der zweiten Grafik[87]A.a.O., S. 10 wird der STS als Kontrollprozess, bezeichnet als Rehearsal-Buffer, in Form eines computertechnischen Schieberegisters (für die Signale) grafisch abgebildet. In der Kontrolleinheit gibt es nun numerierte Slots und „verlorene Signale“, wenn diese aus dem Speicher „fallen“, bzw. „verfallen“ (decay) oder durch neue Signale überschrieben werden.

Die Verschränkung von Speicher und Steuerung ist im Modell von Anfang an angelegt und spiegelt speziell im Kurzzeitspeicher, wie bereits bei Frank, die Von-Neumann-Architektur wider. Diese war zu dieser Zeit so selbstverständlich, dass sie offensichtlich keiner gesonderten methodischen Erwähnung bedurfte. „Wie ein eingehender Reiz verarbeitet wird“, so schreiben Atkinson & Shiffrin zu Beginn, hänge ja „von den jeweiligen Steuerungsprozessen ab“, welche wiederum von den Menschen „ins Spiel gebracht“ werden.[88]A.a.O., S. 1, eigene Übersetzung: „In the sense that the computer’s method of processing a given batch of data depends on the operating program, so the way a stimulus input is processed … Continue reading Weiter betonen sie, und hier setzen sie nun die Tradition der semantischen Urverdrängung fort, dass das Üben „einer der wichtigsten Faktoren“ bei der Erklärung des menschlichen Gedächtnis sei, gerade weil sich die Experimente des Kurzzeitgedächtnissses oft auf bedeutungslose Aufgaben beziehen würden.[89]A.a.O., S. 9, eigene Übersetzung: „Rehearsal is one of the most important factors in experiments on human memory. This is particularly true in the laboratory because the concentrated, often … Continue reading Wobei sie davon den Langzeitspeicher durch seine spezielle Form der „Kodierung“ zunächst ausnehmen.

Den Long-Term-Store (LTS), also den Langzeitspeicher, behandeln Atkinson & Shiffrin am Ende nicht mehr ganz so ausführlich. Die epistemische Grundannahme ist auch hier weiterhin das Computermodell. Weil, wie sie schreiben, die einfachste „Hypothese“ die sei, anzunehmen, dass es bei einem „korrekten Abruf“ eine „korrekte Antwort“ geben wird.[90]„The simplest hypothesis is to assume that the trace is all-or-none; if a trace is placed in memory, then a correct retrieval and response will occur.“ Dahinter liegt die Logik einer Datenbank- oder auch Festplattenabfrage: binär, verlustfrei und kontextunabhängig. Mit anderen Worten: Entweder ein Eintrag ist vorhanden und wird korrekt ausgegeben, oder er ist nicht vorhanden. Tertium non datur. Damit verschwindet am Ende auch aus dem Langzeitspeicher das semantische Element: Beim Erinnern gibt es „immer“ eine „korrekte Antwort“ im Sinne eines Vergleichs mit einem gespeicherten Eintrag.

Erinnern vs. Gedächtnis

„Long before this, Ebbinghaus had introduced the ‚exact methods’ of nonsense syllables into the Laboratory consideration of memory. As in duty bound, I followed his lead and worked for some time with nonsense material. The result was disappointment and a growing dissatisfaction.“

Frederic Bartlett 1932, S. V[91]Bartlett, Frederic C. (1932). Remembering: A Study in Experimental and Social Psychology

Am Ende des Aufsatzes untersuchen Atkinson & Shiffrin das Langzeitgedächtnis und diejenigen Kontrollprozesse, „die der willentlichen Kontrolle des Subjekts unterliegen, wie beispielsweise Wiederholung, Kodierung und Suchstrategien“.[92]A.a.O., S. 42, eigene Übersetzung. Durch das von ihnen skizzierte Wiedererkennen (recognising) als Signalabgleich zwischen Kurzzeit- und Langzeitspeicher fiel das Denken endgültig, also sowohl begrifflich als auch funktional, aus dem Modell. Umgekehrt wurde der Kurzzeitspeicher, weil er als Analogie zum menschlichen Denken, mit den Begriffen Entscheidung („decision making“) und Kontrolle („control“) bereits im Titel versehen wurde, zum Ersatz dafür. Das „Gedächtnis“ wurde nun im Sinne einer Behältervorstellung und als Informationsverarbeitungssystem wirksam, obwohl Menschen sich normalerweise rekonstruktiv, kontextabhängig, emotional gefärbt und sozial eingebettet an Gedachtes erinnern.[93]Remembering, wie Bartlett es bereits 1932 festhält, wäre begrifflich für eine phänomenale Beschreibung besser geeignet gewesen. „It is generally pointed out that remembering is a more … Continue reading Mit anderen Worten: Weil der analogische Charakter des Vorbildes vollständig verschwunden ist, werden fortan nicht nur Informationen, sondern auch Erfahrungen und Überlegungen durch das Gedächtnissystem enkodiert und später wieder abgerufen, was man individuell durch wiederholen (rehearsal) optimieren kann.[94]Zimbardo 1992, S. 268f, kursiv im Original, fett durch mich. „Die meisten Kognitionspsychologen definieren Gedächtnis als aktiv warnehmendes kognitives System, das Informationen aufnimmt, … Continue reading

Da das Langzeitgedächtnis eine semantische Leerstelle im Sinne eines Erinnerns geblieben war, wurde es im Laufe der Rezeptionsgeschichte durch die Kognitionswissenschaft mit dem angefüllt, was bis dahin als Denken und dessen Ergebnis skizziert worden war. So folgte die heute übliche Unterscheidung des Langzeitgedächtnisses in ein deklaratives Gedächtnis, in paradigmatischer Unterscheidung vom prozeduralen Gedächtnis.[95]Beispielsweise Cohen, N. J. & Squire, L.R. (1980): Preserved Learning and Retention of Pattern-Analyzing Skill in Amnesia. In: Science 210, S. 207–210 Das deklarative Gedächtnis wiederum umfasst nach heutiger Definition das episodische (biografische)[96]Tulving, E. (1983): Elements of Episodic Memory. und das semantische Gedächtnis.[97]Tulving, E. (1972). Episodic and semantic memory. In Organization of memory, S. 381 – 403 Geblieben ist damit die Vorstellung des Langzeitgedächtnisses als großer „‚Speicher‘ für alle Erfahrungen, Informationen, Emotionen, Fertigkeiten, Wörter, Kategorien, Regeln und Urteile“,[98]Zimbardo 1992, S. 279 der die Formen abrufbar bereithält. Und die aus dem Modell abgeleitete Vorstellung, wie es oft ergänzend erwähnt wird, dass dieser Speicher nahezu unbegrenzt sei bzw. eine gespeicherte Information „für immer im Gedächtnis behalten wird“.[99]A.a.O., S. 270

Semantik 1: Gedächtnis als falsche Analogie

Am Ende des Beitrages möchte ich auf das grundsätzliche Problem des gesamten Mythos eingehen, das darin besteht, dass es sich sowohl bei den „Versuchen“, als auch bei den Testbedingungen und sogar bei den theoretischen Grundlage jeweils um eine falsche Analogie dessen handelt, was Menschen beim Denken und mit dem Gedachten tun. Das werde ich an den Schlussfolgerungen von Ebbinghaus und Miller sowie der Kommunikationstheorie von Shannon aufweisen, wobei ich mit letzterem beginne, weil sie als theoretische Basis unsichtbar im Modell hinterlegt ist.[100]Zumindest Atkinson & Shiffrin erwähnen Shannon nirgends explizit. Das von ihm entwickelte Sender-Empfänger-Modell ist jedoch die Grundlage in Bezug auf das Thema Kommunikation, weshalb ich das … Continue reading Das gilt nicht nur funktional in Bezug auf das Verständnis von Kommunikation als semantisch entleerte, also rein syntaktische Übertragung zwischen den Speicherebenen, sondern vor allem für die „Legende“ von Informationen[101]Zur technisch-historischen Genese ausführlich und sehr gut Peter Janich (2006): Was ist Information? Kritik einer Legende. als speicherbarer eigenständiger und diskreter Entitäten[102]Siehe hierzu Norbert Wiener mit seiner Petitio Principii in „Cybernetics or control and communication in the animal and the machine“ (1985), S. 180: „Information is information, not … Continue reading im Rahmen des Mythos.

Shannon formuliert selbst und explizit, dass sein Gebrauch des Begriffs Information nicht in einem gewöhnlichen und gebräuchlichen Sinn verstanden und vor allem „nicht der Bedeutung gleichgesetzt werden“ darf.[103]Shannon & Weaver (1976), kursiv im Original: Mathematische Grundlagen der Informationstheorie. „Das Wort Information wird in dieser Theorie in einem besonderen Sinn verwendet, der nicht mit … Continue reading Shannon war sich also bewusst, dass die menschliche Art einer Informationsübertragung, beispielsweise durch die Sprache, „sich nicht unbedingt in Bits messen“ lassen würde.[104]Zitiert nach Kirchartz a.s.O., S. 145: „Auf einem Treffen des Neuroscience Research Program 1968 stellt Shannon dann auch klar, dass selbst ein rein quantitativer Informationsbegriff für die … Continue reading Er wollte als Ingenieur lediglich das technisches Problem einer ungestörten Signalübermittlung lösen. Dafür definierte er ein Zeichenrepertoire, aus dem ausgewählt wird, und wählte den Weg, den zu übermittelnden Informationsgehalt axiomatisch über die Auftretenswahrscheinlichkeit von Zeichen zu fassen. Je unwahrscheinlicher ein symbolisches Ereignis, also beispielsweise das Vorkommen eines Buchtsaben, ist, desto höher ist nun statistisch sein Informationsgehalt.[105]Mit anderen Worten: Je unwahrscheinlicher ein Ereignis ist, desto mehr Information trägt es. Für Shannon spielt es auch keine Rolle, was übertragen wird, sondern nur, wie viele Unterscheidungen … Continue reading Diese mathematische Operationalisierung war ihm deshalb möglich, weil er vorab eine ziemlich bedeutungstragende Entscheidung getroffen hatte. D.h., die mathematische Bedeutungsfreiheit ist keine genuine Eigenschaft des Sender-Empfänger-Modells, sondern eine explizit vorausgesetzte Rahmenbedingung.

Um die Auftretenswahrscheinlichkeiten berechnen zu können, gebrauchte Shannon ein bereits definiertes Zeichenrepertoire: die englische Sprache.[106]Shannon hat in seiner ursprünglichen Arbeit zwei Zeichenrepertoires verwendet. Das binäre Alphabet, also die Ziffern 0 und 1, sind das abstrakte Grundmodell, worauf er den Begriff des … Continue reading Erst darüber konnte er überhaupt mathematisch festlegen, welche Zeichen möglich sind und was sie jeweils bedeuten.[107]Mit anderen Worten: Um „Speicher“, „Kontrolle“, „Enkodierung“ als sinnvolle Begriffe zu verwenden ist die Semantik im Sinne einer inhaltlichen Bedeutung der … Continue reading Shannons Informationstheorie ist definitorisch – und deshalb nur innerhalb ihres mathematischen Rahmens – bedeutungsfrei. Die Entscheidungen darüber, was als Zeichen, als Kanal und als Zeichenvorat in der Theorie gilt, waren bedeutungstragende Festlegungen, die außerhalb der Theorie getroffen wurden. Bereits auf der begrifflichen Ebene der Gedächtnismodelle ist es insofern „illegitim, von ‚Signalen‘ oder ‚Zeichen‘ bzw. ‚Zeichenvorrat‘ zu sprechen“.[108]Janich, Peter (2006): Was ist Information? Kritik einer Legende, S. 83: „Es ist in der Nachrichtentechnik schlichtweg illegitim, von ‚Signalen‘ oder ‚Zeichen‘ bzw. … Continue reading Die theoretischen Entscheidungen sind generell mit Sinn „vorbelastet“, weil „allein semantisch und pragmatisch kompetente, sprachfähige Menschen selbst […] die sprachlichen Gegenstände und deren Bedeutung, Geltung und Zusammensetzung“ erzeugen und verstehen.[109]Janich a.a.O., S. 83. Auslassung durch mich.

Was als ingenieurstechnische Problemlösung begann wurde durch die Rezeptionsgeschichte zur petitio principii: Das mathematisch-statistische Vorgehen setzt im Vollzug der eigenen Operationalisierung voraus, was es eigentlich ausschließen sollte.[110]Erwähnenswert sind hierbei vor allem Carnap, R., & Bar-Hillel, Y. (1952) mit An Outline of a Theory of Semantic Information (Technical Report No. 247) sowie Dretske, F. I. (1981) mit Knowledge … Continue reading Wissenschaftsetheoretisch gesprochen ist die semantische Kompetenz der Menschen eine zumeist implizite Kontrollvariable des gesamten Modells. Das gilt jedoch nicht nur auf der theoretischen Ebene, sondern auch im experimentellen Design, wie es etwa Ebbinghaus und Miller gestaltet und tradiert haben. Die vorgebliche Bedeutungsfreiheit der Silben im Rahmen von Ebbinghaus‘ Selbstversuch war eine bewusste experimentelle Grundentscheidung, mit der er Bedeutung und Sinn als Störvariable ausschalten wollte. Miller wiederum überträgt dieses Vorgehen generell und ebenfalls bewusst auf die menschliche Wahrnehmung bzw. auf das Gedächtnis im Sinne einer Merkfähigkeit.[111]Auch Atkinson & Shiffrin setzen die Bedeutungslosigkeit voraus, weil sie davon ausgehen, dass „eingehende Informationen“ als rein diskrete Einheiten ankommen, die gezählt und … Continue reading Die Bedeutungsfreiheit ist auch bei ihnen kein objektiver Ausgangspunkt, sondern ein theorieinternes Konstrukt der Operationalisierung.

Bei Ebbinghaus brachte er selbst und bei Miller brachten die Proband:innen die Variable Bedeutung bzw. Sinn dennoch und unweigerlich ins Spiel, ohne dass dies erfasst oder reflektiert wurde. Die sinnfreien Silben bestanden immerhin aus bedeutungstragenden Buchstaben ihrer gesprochenen Sprache.[112]Es waren also gerade nicht völlig bedeutungsfreie Silben, sie war nur auf der Silbenebene bewusst bedeutungsfrei. Insofern haben sie in den Tests automatisch versucht, sinnvolles im bewusst unsinnvollen zu entdecken. So gesehen stellt das Chunking die Möglichkeit von Menschen dar, auch bezüglich zunächst sinnlosem Material sinnhafte Verknüpfungen herzustellen. Mit anderen Worten: wem es gelang, die sinnfreien Silben mit einer Bedeutung zu versehen, der konnte besser wiederholen und größere Chunkeinheiten bilden. Das hat zwar viel mit Sprechen, Denken und Gedachtem zu tun, aber überhaupt nichts mit dem Gedächtnis als Speichermodell. Insofern war und ist der Mythos, der aus der Analogie folgt(e) und heute allgegenwärtig ist, schlichtweg falsch.

Semantik 2: Erinnern als adäquates Modell

Dadurch, dass die Analogie endgültig zum Mythos geworden war, weil es rezeptionsgeschichtlich – als circulus vitiosus der angedachten Naturalisierung geistiger Leistungen durch die Kybernetik – „zu einem aktiv wahrnehmenden kognitiven System“ reifiziert wurde, ist auch der Umstand, dass es sich beim Erinnern um ein sinnhaftes sprachliches Geschehen im Rahmen von menschlichen Praktiken handelt, nachhaltig verdrängt worden.[113]Hierzu erhellend und deutlich abgrenzend Harald Welzer (2011): Das kommunikative Gedächtnis: Eine Theorie der Erinnerung. Bei der weiteren Untersuchung bezüglich des Denkens möchte ich deshalb dort anfangen, wo Ebbinghaus und Miller, Atkinson und Shiffrin, aber auch Steinbuch und Frank, gerade nicht angefangen haben. Die grundlegenden Fragen daran, was Zeichen sind und was sie konstituiert, wie sie vor allem wahrgenommen werden oder sogar umgekehrt die Wahrnehmung beeinflussen. Um diese Fragen beantworten zu können ist ein Blick auf die Eingangsebene, also das, was im Drei-Ebenen-Modell des Gedächtnisses computersprachlich ursprünglich als sensorische Register bezeichnet worden war, notwendig.

Auch die aus dem Modell und den Experimenten ausgeklammerte Semantik hält sich rezeptionsgeschichtlich hartnäckig, denn sie ist die Bedingung der Möglichkeit des Denkens und Erinnerns. Das musste selbst die Psychologie feststellen, weil es Menschen nachweislich nicht gelingt, im Langzeigedächtnis „einen Satz oder einen Abschnitt, dessen Bedeutung man nicht verstanden hat, zu einer ‚erinnerbaren‘ Informationseinheit zu organisieren“.[114]Zimbardo a.a.O., S. 280. Dieser Befund erscheint nicht als Kritik am Modell, sondern als selbstverständliche Ergänzung. Auch sonst übernimmt Zimbardo das Vokabular des Modells, wie etwa … Continue reading Wesentlich tiefgreifender ist jedoch die Frage, inwiefern nicht die Informationen oder Reize, sondern die „bisherigen Wahrnehmungserfahrungen“ bereits prägen, was wir als Menschen überhaupt erkennen und wie wir die Welt, im wahrsten Sinne des Wortes, „sehen“, wenn wir sie mit sprachlichen Kategorien erfassen.[115]Siehe hierzu treffend Lupyan, G., Abdel Rahman, R., Boroditsky, L., & Clark, A. (2020): Effects of Language on Visual Perception. Trends in Cognitive Sciences, 24(11), S. 930–944, auf das sich … Continue reading Das möchte ich am Ende am Beispiel der Farbwahrnehmung aufgreifen, weil dies ein äußerst erhellendes ist.

Die Farbwahrnehmung von Menschen ist gut untersucht und deshalb ein treffendes Beispiel für die Untersuchung des Gedächtnisses, weil der physikalische Reiz, also der nicht semantische Informationsgehalt, kontinuierlich vorhanden ist, während das Erfassen und Beschreiben deutlich von der jeweils gesprochenen Sprache abhängig ist. Dass wir beispielsweise die Farbe „Magenta“ sehen hängt nicht (nur) von der Wellenlänge des Lichtes ab, sondern davon, dass wir die Farbkategorie „Magenta“ überhaupt kennen und von anderen Farben, die „psychophysisch gleich weit“ entfernt liegen, aber eine andere Bezeichnung haben, unterscheiden können.[116]Das Beispiel der Farbe Magenta ist deshalb von mir gewählt, weil sie im Zuge der Ausgründung der Deutschen Telekom AG von der ehemaligen Deutschen Bundespost und kurz vor dem Börsengang aus … Continue reading Das setzt voraus, „dass man Farben in sprachlich benannte Kategorien einteilt“,[117]Lupyan et al., a.a.O., S. 933, eigene Übersetzung: „What makes color an excellent domain of study is that the physical stimulus is continuous, but we tend to talk about it categorically. … Continue reading was wiederum eine Eigenschaft des Langzeitgedächtnisses ist, die nicht aus einem Informationsabgleich mit einem Speicher oder hinterlegten Zeichenpool besteht.[118]Lupyan et al. nennen es einen „Off-Line Einfluss“ und meinen damit, dass eine Langzeiterfahrung mit einer bestimmten Sprache dauerhaft verändert, wie perzeptuelle Inputs von Menschen … Continue reading Mit anderen Worten: Bereits Wiedererkennen im allgemeinen „heißt kategorisieren“.[119]A.a.O., S. 931: „To recognize is to categorize“. Obwohl erfahrungsbedingt, und damit erlernt, greift die farbliche Unterscheidungsfähigkeit („Diskrimination“) jedoch bereits wesentlich früher, nämlich auf der Eingangsebene,[120]Lupyan et al. nennen dies einen „On-Line Einfluss“ und meinen damit, dass aktuelle sprachliche Aktivität, z. B. das Hören eines Wortes, in Echtzeit auf die visuelle Verarbeitung … Continue reading also im Modell auf der Ebene des „Sensorischen Gedächtnisses“, als Vorselektion.[121]In der Psychologie ist das sensorische Register begrifflich mittlerweile gleichbedeutend mit dem sensorischen Gedächtnis. Vgl. hierzu Zimbardo 1992, S. 271ff. Auch in der Kognitionswissenschaft wird … Continue reading

Es gibt noch eine dritte wichtige Ebene, die man mit dem vergleichen muss, was im Modell den Kurzzeitspeicher, der das Denken ersetzt hatte, darstellt. Die elementarste Wahrnehmungsleistung ist die, überhaupt etwas, und zwar als etwas spezifisches,[122]Vgl. hierzu Keller (1989): Sprachphilosophie, S. 121: Der Mensch erfasst Eindrücke „nach einem ganz überwiegend erlernten Schema, das man als die ‘Als-Struktur’ des Erkennens genannt hat, … Continue reading zu erkennen.[123]Lupyan et al. nennen dies „Detektion“ bzw. „Predictive Processing“ und meinen damit eine „predictive inference“ in dem Sinne, dass die Perzepte „best … Continue reading „An etwas denken heisst sich dessen in irgendeiner Weise bewusst sein“ schreibt John Dewey dazu. Er präzisiert, dass sich das Denken von Menschen auch auf das bezieht, „was nicht unmittelbar wahrgenommen wird, auf das, was wir nicht sehen, riechen, hören, berühren“. Wenn wir über etwas nachdenken oder auf etwas reflektieren, dann tut das nicht ein passiver Kurzzeitspeicher. Nur das Denken „mit einer wahrgenommenen und registrierten Tatsache, gefolgt von etwas, das nicht beobachtet, aber durch die auf die Sinne einwirkenden Objekte hervorgerufen wurde“ ist die richtige begriffliche Charakterisierung für dieses Phänomen.[124]Dewey, J. (2009): Wie wir denken, S. 8 – 12 Damit ist der endgültige Übergang zum zweiten Teil dieses Blogeintrags grundgelegt.

Noch einmal erweitert: Das menschliche Gedächtnis ist kein „Desktop-Computer, der darauf ausgelegt ist, Unmengen an Informationen zu speichern“[125]A.a.O., S. 5, eigene Übersetzung: „The human mind is not like a desktop computer, designed to hold reams of information.“ und Menschen denken nie alleine.[126]So bereits der Untertitel des lesenswerten Buches von Sloman, S., & Fernbach, P. (2017): The knowledge illusion: Why we never think alone. Das gemeinsame Denken erst macht intersubjektives Wahrnehmen und die kollektive Sprache gemeinschaftliches Kategorisieren, und damit Wissenschaft, überhaupt erst möglich.[127]Das gemeinsame Denken ist mittlerweile sogar über das so genannte Hyperscanning nachweisbar. Im Rahmen einer „Collaborative Cooperation (CC)“ arbeiten die Teammitglieder gemeinsam an … Continue reading Die Intelligenz von Menschen befindet sich insofern nicht in den „einzelnen Gehirnen“, sie ist im „kollektiven Verstand“ verankert.[128]„Our intelligence resides not in individual brains but in the collective mind“ (A.a.O., S. 5). Auch hiermit habe ich mich schonsehr ausführlich hier im Blogbeitrag zum kollaborativen … Continue reading Die zentrale Erkenntnis für die Pädagogik daraus ist die, um den Kreis auch für diesen Beitrag zu schließen, dass ihre Aufgabe nicht die Informationsvermittlung ist, sondern didaktisch das Denken im Rahmen einer Gemeinschaft zu fördern ist.

Damit lässt sich für mich nun am Ende folgender überleitender Satz zum zweiten Teil formulieren:

Das Erinnern von Menschen ist kein Speichervorgang, sondern eine Praxis. Es ist die Fähigkeit zur bedeutungsgenerierenden Verwendung von sprachlichen Symbolen, die sich im gemeinschaftlichen kommunikativen Tun konstituiert und von Grund auf prägt, wie wir die Welt überhaupt wahrnehmen und wie wir über sie denken.

Anmerkungen

| ↑1 | Frank, H. G. (1969). Kybernetische Grundlagen der Pädagogik, Bd. 1, 2. Auflage. Ursprünglich erschienen 1962. |

|---|---|

| ↑2 | Hof, B. E. (2018). Der Bildungstechnologe. In S. Schenk & M. Karcher (Hrsg.), Überschreitungslogiken und die Grenzen des Humanen: (Neuro-)Enhancement—Kybernetik—Transhumanismus |

| ↑3 | A.a.O., S. 3-52 |

| ↑4 | Dies war vor allem das Ergebnis der so genannten Erlanger Schule der Informationspsychologie, die ein „informationspsychologisches Intelligenzmodell“ entwickelte. Mit dem Thema Intelligenz habe ich mich in diesem Beitrag hier ausführlich und kritisch beschäftigt. |

| ↑5 | Die etymologische Herleitung von Claude am 05.04.2026 ergab folgendes Ergebnis:

|

| ↑6 | Steinbuch, K. (1965). Automat und Mensch. Kybernetische Tatsachen und Hypothesen, 3. Auflage, S. 2, kursiv im Original. |

| ↑7 | Kirchartz, Melina (2023): Riskantes Denken: zur Funktion der Mensch-Maschine-Analogie in der Medienwissenschaft, S. 11-21. „Ihre Suggestionskraft gewinnt die Analogie dabei vor allem aus dem vermeintlichen Vermögen, Unverständliches oder bisher Unerklärbares auf einen Schlag verständlich zu machen, indem sie über Ähnlichkeiten, die, obwohl sie überhaupt nichts bedeuten müssen, Plausibilität für die Gleichursächlichkeit von Effekten herstellt“ (S. 21). |

| ↑8 | Leider sind es auch hier überwiegend Männer. Vielleicht habe ich aber auch etwas übersehen, dann bitte ich um Korrekturen. |

| ↑9 | Dass Sprache nicht nur das Denken ausdrückt, sondern es wesentlich auch strukturiert, ist einer der wichtigsten Einwände gegen die Computeranalogie der Kybernetik, die Sprache als neutrales bzw. genauer als bedeutungsfreies Übertragungsmedium behandelt, worauf sowohl Hermann Ebbinghaus, als auch Claude Shannon von sich aus – in Erläuterung ihrer jeweils methodischen Gründe – hingewiesen haben. |

| ↑10 | Wygotskij, Lew (2017): Denken und Sprechen. Psychologische Untersuchungen. Beltz Verlag, 3. Auflage |

| ↑11 | Berger, Peter L. & Luckmann, Thomas (2016): Die gesellschaftliche Konstruktion der Wirklichkeit, S. 56 |

| ↑12 | Atkinson, R., & Shiffrin, R. (1968). Human Memory: A Proposed System and Its Control Processes. Reprint 2024 in Journal of Memory and Language Nr. 136 |

| ↑13 | So beispielsweise der Untertitel von Steinbuch oben. |

| ↑14 | Als Paradigmen der „Normalwissenschaft“ im Sinne Kuhns. Kuhn, T. S. (2023). Die Struktur wissenschaftlicher Revolutionen. Suhrkamp. |

| ↑15 | A.a.O., S. 11-16 |

| ↑16 | Dabei entstehen Zitationszirkel, die durch die pure Wiederholung Wahrheit konstruieren und den hypothetischen Charakter verschleieren, ohne dass jemand aktiv lügt. Die Konstruktionsbedingungen werden einfach „vergessen“. |

| ↑17 | Kirchartz a.a.O., S. 27f |

| ↑18 | A.a.O., S. XIII, kursiv im Original |

| ↑19 | Im Wesentlichen waren es tatsächlich Männer. |

| ↑20 | Mit dem Mythos des kommunikativen Eisbergs habe ich mich in diesem Blogbeitrag umfassend auseinandergesetzt. |

| ↑21 | Paradigmatisch beispielsweise „im Zimbardo“, hier auf den Seiten 268 – 291, auf der Seite 290 sogar dargestellt als Flußdiagramm eines „hypothetischen Gedächtnissystems“. Siehe hierzu Zimbardo, P. G. (1992). Psychologie. |

| ↑22 | Ebbinghaus (1885): Über das Gedächtnis: Untersuchungen zur experimentellen Psychologie, § 12, fett durch mich. |

| ↑23 | Vgl. dazu Ebbinghaus a.a.O., § 29 / S. 103f. Er selbst gewinnt die Zahlen über die Betrachtung des Wiederholens. „Eine Stunde nach Aufhören des Lernens war das Vergessen bereits soweit vorgeschritten, daſs über die Hälfte der ursprünglich aufgewandten Arbeit erneuert werden muſste, ehe die Reihen wieder reproduciert werden konnten“ (S. 104). Die exakten Zahlen werden in den Zitationszirkeln etwas unterschiedlich genannt, bleiben aber auch als exponentielle Funktion nahe bei denen, die Ebbinghaus selbst ermittelt hat. |

| ↑24 | A.a.O, § 22 / S. 70-72 |

| ↑25 | Ebbinghaus a.a.O. Hierzu auch: „Unter vielen tausend Kombinationen begegnen kaum einige Dutzend, die einen Sinn ergeben, und unter diesen wiederum nur einige wenige, bei denen während des Lernens auch der Gedanke an diesen Sinn geweckt wurde.“ |

| ↑26 | Hier der genaue Wortlaut: „[…] so gewinnt man durch Vergleichung der jetzt gefundenen Zahl von Wiederholungen mit den obigen einen wenigstens u n g e f ä h r e n numerischen Ausdruck für die aufserordentlichen Begünstigung, welche der Einprägung von Reihen durch die vereinigten Bande des Sinnes, des Rhythmus, des Reims und der Zugehörigkeit zu einer einzigen Sprache zu Teil wird. Denkt man sich unsere obige Kurve in der Krümmung, die sie einzuschlagen scheint, noch eine Strecke fortgeführt, so mufs man voraussetzen, dafs ich sinnlose Reihen von 70-80 Silben nach 70-80maliger Wiederholung auswendig hersagen könnte. Waren die Silben durch die eben erwähnten Fäden äufserlich und innerlich aneinander gekettet, so reducierte sich also dieses Erfordernis für mich auf etwa 1/10 seines Betrages“ (A.a.O, § 21 / S. 69, gesperrt im Original). |

| ↑27 | a.a.O., § 27 / S. 90 |

| ↑28 | Miller, G. A. (1956). The magical number seven, plus or minus two: Some limits on our capacity for processing information. Psychological Review, 63(2), 81–97. |

| ↑29 | „Preparation of the paper was supported by the Harvard Psycho-Acoustic Laboratory under Contract N5ori-76 between Harvard University and the Office of Naval Research, U.S. Navy (Project NR142-201, Report PNR-174)“ (A.a.O., S. 96). |

| ↑30 | „Der Prozess der Übertragung selbst ist so simpel wie fahrlässig: Denn Wiener übergeht eine Einführung des Begriffs, indem er ihn im Zusammenhang mit der menschlichen Wahrnehmung einfach verwendet. Der Mensch nimmt über die Sinne Informationen auf, die dann weiterverarbeitet werden, wodurch am Ende Handeln bestimmt wird. Worauf Wiener hier offensichtlich setzt, ist die Suggestionskraft die Begriffsanalogien haben können“ (Kirchartz 2023, S. 146). |

| ↑31 | A.a.O., S. 82, eigene Übersetzung |

| ↑32 | „Confusions will appear near the point that we are calling his ‚channel capacity'“ (a.a.O., S. 83). |

| ↑33 | Ermittelt beispielsweise duch das Hören von Tönen, Unterscheiden von Lautstärken, Bestimmung von Salzlösungen oder auch visueller Punkte und Hautreize |

| ↑34 | Ein Bit ist eine physikalische Einheit, die in einem technischen System realisiert wird, um damit in der Binärsprache Zeichen zu kodieren. ASCII wurde als 7 bit Code 1963 als Standard eingeführt, ist mittlerweile jedoch durch UTF-8, also einen 8bittigen Code, als De-facto-Standard im Internet abgelöst worden, weil sich damit mehr Zeichen kodieren lassen. |

| ↑35 | Miller 1956, S. 83: „Two bits of information enables us to decide among four equally likely alternatives. Three bits of information enable us to decide among eight equally likely alternatives.“ |

| ↑36 | Das lässt sich gut am damaligen 7bittigen ASCII-Code zeigen, der möglicherweise die Vorlage für Millers magische 7 war: ASCII stellt als Code bereits eine Zuordnung zwischen Bitmustern und Zeichen dar, der Code ist als Konvention bereits bedeutungstragend. Mit anderen Worten: Das „A“ in ASCII ist nicht bedeutungsfrei, es ist ein übersetzter Buchstabe mit Bedeutung. |

| ↑37 | „If immediate memory is like absolute judgment, then it should follow that the invariant feature in the span of immediate memory is also the amount of information that an observer can retain“ (Miller a.a.O., S. 91). |

| ↑38 | „Absolute judgment is limited by the amount of information. Immediate memory is limited by the number of items. In order to capture this distinction in somewhat picturesque terms, I have fallen into the custom of distinguishing between bits of information and chunks of information. Then I can say that the number of bits of information is constant for absolute judgment and the number of chunks of information is constant for immediate memory“ (a.a.O., S. 92f). |

| ↑39 | Der spezifische Inhalt einzelner Chunks ist dabei ebenfalls ohne jegliche Bedeutung, es geht um eine reine auf Summierung im Sinne einer Clusterbildung. |

| ↑40 | „Intuitively, it is clear that the subjects were recalling five words, not 15 phonemes, but the logical distinction is not immediately apparent. We are dealing here with a process of organizing or grouping the input into familiar units or chunks, and a great deal of learning has gone into the formation of these familiar units“ (a.a.O., S. 93). |

| ↑41 | „In my opinion the most customary kind of recoding that we do all the time is to translate into a verbal code. When there is a story or an argument or an idea that we want to remember, we usually try to rephrase it ‚in our own words.‘ […] In particular, the kind of linguistic recoding that people do seems to me to be the very lifeblood of the thought processes“ (a.a.O., S. 95, fett durch mich). |

| ↑42 | Steinbuch, K. (1965). Automat und Mensch. Kybernetische Tatsachen und Hypothesen, 3. Auflage, 2 Bände. |

| ↑43 | A.a.O., S. 194 |

| ↑44 | Mit anderen Worten: sie übernehmen philosophisch belastetes Vokabular, ohne die philosophische Tradition zu reflektieren oder auch nur zu kennen. |

| ↑45 | A.a.O., S. 194f |

| ↑46 | A.a.O., kursiv im Original |

| ↑47 | Zemanek, Heinrich, beispielsweise „Technische und kybernetische Modelle“ (1961) oder „Regelungsvorgänge in lebenden Wesen“ (1959). |

| ↑48 | A.a.O., S. 199 |

| ↑49 | A.a.O., S. 247 |

| ↑50 | A.a.O., S. 253, fett durch mich. Der Begriff Perzeption hat entgegen Steinbuch eine lange Tradition als bewusste oder unbewusste Wahrnehmung, die immer schon bedeutungsgebunden ist. Sie ist auch erkenntnistheoretisch kein neutraler Eingangskanal. |

| ↑51 | A.a.O., S. 254: „Jedes Sinnesorgan entdeckt eine bestimmte Art von Vorgängen in der Außenwelt. Der Gesichtssinn z.B. entdeckt elektromagnetische Schwingungen mit Wellenlängen zwischen etwa 380 und 760 nm (Nanometer, 10-9 m) und ausreichender Intensität, der Gehörsinn mechanische Schwingungen mit Frequenzen zwischen etwa 16 und 16000 Hz und ausreichender Intensität usw.“ |

| ↑52 | A.a.O., S. 258: „Nur ein enger Bereich (die „fovea centralis“) hat die maximale Sehschärfe. Wenn wir einen Gegenstand genau sehen wollen, drehen wir das Auge so, daß der Gegenstand auf die fovea centralis projiziert wird. In diesem Bereich können wir noch zwei Linien unterscheiden, die einen Abstand von einer Winkelminute haben (das ist in 20 cm Entfernung betrachtet ein Abstand von Millimeter). Außerhalb der fovea centralis nimmt die Sehschärfe rasch ab. Man kann insgesamt etwa 400 000 Bildpunkte unterscheiden.“ |

| ↑53 | A.a.O., S. 259, fett durch mich. Steinbuch weiß also genau, was er tut, denn er schließt Erkennen, also das Verstehen von Bedeutung, bewusst und systematisch aus allen Stufen seiner Reduktion aus. Stattdessen postuliert er Unterscheidungskapazitäten, die er auch noch diskret interpretiert, um aus kontinuierlichen Wahrnehmungsprozessen zählbare Einheiten zu generieren. In der Rezeption verschwinden diese Unterscheidungen, die er selbst vornimmt, vollständig. 200 Millionen bit/sec werden zur Kapazität menschlicher Wahrnehmung beim Sehen schlechthin. Hinzu kommt, dass er den Bit-Begriff inkonsistent verwendet: In der Rechnung als technische Einheit der Kodierung, generell als Ja/Nein-Unterscheidung. Die Zahl 200 Millionen bit/sec entsteht auch durch die äquivoke Verwendung des Bit-Begriffs, was die scheinbare Präzision der Rechnung vollends unterminiert. |

| ↑54 | Die Rechnung ist mathematisch inkorrekt, weil die Zahl 8 eigentlich für einen Code von 256 Helligkeitsstufen steht. Entweder hätten hier die 256 Stufen stehen müssen, oder aber sowohl die 400.000 Bildpunkte, als auch die 60 unterscheidbaren Bilder in einer Sequenz hätten in einem entsprechenden Binärcode umgewandelt werden müssen. Daneben sind es drei verschiedene Maßzahlen, die man nicht einfach mal multiplizieren kann, ohne die Einheit geklärt zu haben. |

| ↑55 | A.a.O., S. 264: „Dieses Zeitquant liegt (für den gesunden Menschen) bei etwa 1/16 Sekunden gleich etwa 65 Millisekunden. Dies ist etwa der Zeitabstand, in dem zwei sichtbare Bilder ineinander verfließen, oder der Zeitabstand, in dem aufeinanderfolgende Druckwellen nicht mehr einzeln, sondern als Ton empfunden werden.“ |

| ↑56 | Frank, Helmar G. (1969): Kybernetische Grundlagen der Pädagogik. Eine Einführung in die Pädagogistik für Analytiker, Planer und Techniker des didaktischen Informationsumsatzes in der Industriegesellschaft. Band 1 und Band 2, völlig neu bearbeitete und wesentlich erweiterte Auflage. Erstauflage 1962. Alle Zitate dieses Abschnitts beziehen sich auf Band 2. |

| ↑57 | A.a.O., S. 62f: „Denn eben weil die Begriffe und Modelle der Kybernetik ihren Ursprung im Prozeß des Objektivierens geistiger Arbeit haben, dieses Objektivieren aber gerade nicht notwendig ein Imitieren sein mußte, besteht bei der Rückübertragung der Strukturen der Objektivation auf deren Urbild, nämlich den Bewußtseinsprozeß, eine erhöhte Gefahr der vorschnellen Gleichsetzung von Modell und Wirklichkeit.“ |

| ↑58 | Die genaue Genealogie dieser Modellstruktur, ob Frank es also übernimmt und verstärkt (was ich vermute) oder ob er es originär erfunden hat, bleibt einer weiteren wissenschaftshistorischen Untersuchung vorbehalten. |

| ↑59 | A.a.O., S. 87f: „Beim Vergleich mit der Speicherkapazität des Akkumulators unseres einfachen Digitalrechners […] ist zu beachten, daß der Kurzspeicher gemäß Bild 97 mehr Aufgaben übernimmt als der Akkumulator eines Digitalrechners, nämlich auch noch Funktionen, welche der Programmsteuerung entsprechen“. |

| ↑60 | A.a.O., S. 63: „Es bedarf der klaren Einsicht, daß von einem (künftig genau zu definierenden) Modell gesprochen und über dieses — nicht über den Menschen – Theoreme bewiesen werden, damit die Informationspsychologie als exakte (theoretische) Informationspsychologie unanfechtbar wird.“ |

| ↑61 | A.a.O., S. 64 |

| ↑62 | A.a.O., S. 62f |

| ↑63 | A.a.O., S. 68. Dass Frank ausgerechnet den Begriff der „Apperzeptionsgeschwindigkeit“ wählt ist besonders bezeichnend, weil er damit einen philosophisch reichaltigen Begriff für bewusstes Verstehen wählt. Die daraus abgeleitete Apperzeptionsgeschwindigkeit ist ja nicht nur eine methodische Vereinfachung, es ist die Ersetzung eines philosophischen Begriffs durch eine reine Maßzahl. |

| ↑64 | A.a.O., S. 68, fett im Original: „Unter der Voraussetzung, daß die Funktion psychologisch interessanter Teile des Gehirns durch das Modell eines synchron (d. h. mit einem Taktgeber) arbeitenden Rechners angemessen beschrieben werden kann, ist die Grundtaktzeit als Reizschwelle des Zeitsinns, als „subjektives Zeitquant“ (SZQ), anzusprechen.“ |

| ↑65 | Physiologisch verweist er auf Steinbuch, den er auch direkt zitiert. Ein SZQ reicht aus, um „eine nervöse Erregung bis an die Peripherie des Körpers und wieder zurück zu leiten (ein Weg von 2 + 2 = 4 Metern wird bei einer mittleren Geschwindigkeit der Nervenleitung von 60 Metern je Sekunde in 1/15 Sekunde zurückgelegt)“. |

| ↑66 | A.a.O. ,S. 68f: „Die Behauptung einer diskontinuierlichen, quantenhaften Natur des Zeitsinns findet sich schon bei W. Wundt […] Der erste, der ein subjektives Zeitquant („Moment“) als kleinste Einheit des Zeitsinns ansetzte, dürfte K. E. von Baer […] gewesen sein. Er schätzte das SZQ zu 1/10 — 1/6 sec.“ |

| ↑67 | A.a.O., S. 72, fett im Original: „Sinnvollerweise wird man jene Zeitspanne als Sättigungsgrenze bezeichnen, während welcher ein eben bewußtgewordener Reiz, ohne daß eine Konzentration auf ihn erfolgte, bewußt bleibt, also die Gegenwartsdauer.“ |

| ↑68 | A.a.O, S. 76: „In der Informationsästhetik spielt die Gegenwartsdauer eine große Rolle, entspricht sie doch den künstlerischen Einheiten der Musik („Motiv“, „Phrase“ — also Thema ohne Variation), der Lyrik (Vers oder kürzere Strophe), der Mime (Bewegungsstück) — Einheiten, die nur deshalb als Einheiten empfunden werden können, weil sie in ihrer Gesamtheit gegenwärtig sein können, d. h. nicht länger als die Gegenwartsdauer sind.“ |

| ↑69 | A.a.O., S. 78, kursiv und fett jeweils im Original |

| ↑70 | A.a.O., S. 79, Beschriftung von Bild 100, fett durch mich. |

| ↑71 | Was methodisch exakt daherkommt ist in Wirklichkeit die experimentelle Herstellung eines menschenunähnlichen Zustands, um dann Aussagen über menschliches Gedächtnis zu treffen. Deshalb sagt das Modell auch nichts darüber aus, wie sich Menschen wirklich erinnern, sondern nur darüber, wie sie sich erinnern, wenn man alles Symbolische und das Denken eliminiert hat. |

| ↑72 | A.a.O., S. 85f |

| ↑73 | Beispielsweise Morin, Forrin und Archer (1961): Information processing behavior: The role of irrelevant stimulus information. |